Ulm Paunel-Freiberuflicher IT-Spezialist

Tagessatz prüfen

Erfahrungen

DataStage ETL Experte

ING Bank

- Datastage 11.7, dbt, Oracle 19, Python 3.12 / PySpark 3.5, Azure GitHub, Azure DevOps, Automic

- Entwicklung von Migrations-Jobs zur Übertragung der Daten aus dem Collection-DWH in den neuen Risk Mart sowie Entwicklung von ETL-Strecken zur Migration historischer Daten vom alten Mart in den neuen Risk Mart.

- Speicherung der Silver Layer auf Hadoop und der Gold Layer in Oracle.

- Übersetzung von DataStage-Jobs in dbt zur Veröffentlichung von Berichtsdaten in der Google Cloud auf eine PostgreSQL-Datenbank.

- Erstellung und Optimierung komplexer SQL-Abfragen zur Datenextraktion aus einem Data Vault unter Berücksichtigung der Historisierung in den Point-in-Time-Tabellen.

- Erstellung von Oracle-Tabellendefinitionen (DDL) und Anpassung bestehender Stored Procedures.

- Versionierung der Änderungen in GitHub und Deployment über das CI/CD-Portal.

- Umbau von DataStage-Langläufer-Jobs in Python unter Einsatz von PySpark zur Reduzierung der Serverlast.

- Migration von SAS-Skripten nach PL/SQL einschließlich Neuentwicklung von Verteilungsfunktionen ohne direktes Äquivalent in Oracle.

- Entwicklung von Automic-Jobs zur Ausführung von DataStage-Strecken und Python-Skripten (PySpark-Jobs), die die Befüllung der SME- und Institutional-Risk-Tabellen im Risk Mart steuern und fachliche Berechnungen ausführen.

- Teilnahme am agilen Prozess, einschließlich der Erstellung von User Stories, Schätzungen und Planung in Azure DevOps.

- Bearbeitung von Azure DevOps-Tickets und enge Zusammenarbeit mit Testern und Fachbereichen zur Fehleranalyse und -behebung.

DataStage ETL Experte

KKH Hannover

- Datastage 11.7, Talend 8.3, DB2 zOs, DB2 LUW, Postgres, MongoDB, Redhat 8, AWS (Lambda, Terraform), Git, Shell, Spark/Scala, Python

- Plausibilitätsprüfungen von Daten-Mappings, um die Migrationsanforderungen mit der aktuellen Tabellenstruktur und den Tabelleninhalten zu harmonisieren.

- Aufbau von DataStage-Strecken auf dem Quellsystem für die Datenmigration stationärer und ambulanter Reha-Themen sowie Partner, juristische Personen, Reha und Bearbeitung von Ansprüchen aus dem Ausland.

- Entwicklung von Talend-Strecken zur Übertragung von Daten von S3 in Datenbanken sowie von S3 nach Spark, um Stammdaten mit anderen IT-Systemen zu teilen sowie Metriken und KPIs zu berechnen und in Qlik bereitzustellen.

- Neuimplementierung der Verarbeitung großer XML-Datenmengen als Spark-Anwendung auf Basis von DataFrames im Rahmen der Post-Migration, in der DataStage nicht mehr zur Verfügung stand.

- Entwicklung von Shell-Skripten zur Integration der neuen Spark-Prozesse in den bestehenden Hauptausführungsplan.

- Weiterentwicklung eines Python-basierten Gateways zur Qualitäts- und Integritätsprüfung von migrierten Daten auf S3.

- Deployment der Python-Funktionalität als Lambda via Terraform-Skripte.

- Teilnahme am agilen Prozess, einschließlich der Erstellung von User Stories, Schätzungen und Planung.

- Bearbeitung von JIRA-Tickets, Pflege der Confluence-Dokumentation und Synchronisierung der JIRA-Tickets mit den jeweiligen Job-Versionen.

Experte für Datenmodellierung, ETL und API-Entwicklung

Deutsche Bundesbank

- Datastage 11.7, IBM MQ Series, Kafka, DB2 zOs 12, Oracle 19.1, SVN, Git, Confluence, Jira, Power Designer, C++, Python, Cobol, JCL, CICS, Tivoli TWS, TSO/ISPF, Java, Spring Boot, Apache Camel, VS Code, GoLang, Redhat Linux 7.6-8, Azure SQL Database, Azure Data Factory (SSIS in Azure), PowerBI

- Entwicklung von DataStage-Strecken für die Beladung von Core Warehouse Layer, Business Vault sowie Enterprise Layer.

- Entwicklung von C++-Erweiterungsroutinen für DataStage sowie von Bash- und Python-Skripten zum Deployment zwischen Umgebungen.

- Ergänzung von DataStage-Sequenzen innerhalb der Tivoli TWS-Orchestrierung.

- Konzeption und Erweiterung einer REST-basierten RTGS-API (Realtime Gross Settlement) in Go zur Bereitstellung von KPI- und Zahlungsverkehrsinformationen.

- Entwicklung von Apache-Camel-Routen auf Basis von Spring Boot zur gesicherten Übertragung von JSON-Dateien.

- Pflege und Erweiterung des logischen und physikalischen Datenmodells (PDM) mittels PowerDesigner, inklusive Automatisierung der SQL-Generierung.

- Veröffentlichung von Daten auf Azure SQL DB und Übertragung auf Azure Data Lake mit Weiterverarbeitung durch Data Factory.

- Verwendung von Pandas (Python) zur Bereinigung von Daten vor der Integration.

- Entwicklung von PowerBI-Dashboards zur Darstellung von KPIs der Zahlungsabwicklung unter Einsatz von DAX.

- Anbindung von Power BI an den Business-Vault-Layer eines Data-Vault-basierten Data Warehouses.

- Entwicklung, Debugging und Umsetzung der Migration von VSAM-Daten in DB2-Tabellen mit COBOL, CICS und JCL.

- Weiterentwicklung des Business Vault Datenmodells und der ETL-Strecken zur Bereitstellung der Dashboard-Daten.

- Durchführung von Incident-, Problem- und Change-Management-Prozessen nach ITIL-Vorgaben für das Target2-Data-Warehouse.

Experte für ETL, Datenbankmodellierung und -entwicklung

L-Bank

- Talend 7.3, Java 11, SAP Hana, Informix, Oracle 19, SQL Server, Postgres, REST, Spring Boot, SVN, Git, Jenkins, Ansible, Python, Docker, Prometheus, Grafana, Confluence, Jira, Redhat 8

- Analyse der Anforderungen des Fachbereichs und der Schnittstellen diverser Softwaremodule.

- Integration von Schnittstellen und zentralem Datenmodell.

- Migration eines alten JSF/Spring Dokumenten-Management-Systems zu einer neuen Python/Django-basierten GUI.

- Entwicklung und Test von Queue-basierten Genehmigungsprozessmodulen.

- Bereitstellung von Testdaten und Durchführung von Tests sowie Defektbearbeitung.

- Entwicklung von Talend-Strecken zur Migration von Dokumenten und Berichten in das Ziel-DMS.

- Übertragung von Daten zwischen Informix, Oracle und SAP Hana Datenbanken.

- Implementierung von Microservices zur Datenpropagation für das neue Frontend.

- Konzeption und Implementierung von Talend-Jobs zur monatlichen anonymisierten Verarbeitung von Forderungsauftragsdatensätzen.

- Definition von Prozessen in Confluence und Pflege von JIRA-Tickets.

- Entwicklung von Jenkins-Skripten für das Deployment von Artefakten auf Nexus und in die Zielumgebungen.

- Entwicklung von Skripten zur Ausführung von Talend-Strecken und UC4-Skripten zur Shell-Skript-Steuerung.

ETL Experte

Atruvia (Fiducia)

- Datastage 11.5, C, Redhat Linux, AWS (S3, Snowflake, Databricks, Lambda, Airflow, Terraform, Quicksight, GitLab), DB2 zOS 12.0, SQL Server, Python, Cobol, TSO/ISPF, JCL, CICS, Oracle, Navicat Data Modeler

- Plausibilitätsprüfungen und Weiterentwicklung von Fachkonzepten und Daten-Mappings.

- Reverse Engineering von COBOL-Programmen zur Identifizierung von Abfrage- und Aggregationslogik für die Berichtsdatenerstellung.

- Erstellung logischer und physischer Datenmodelle auf Basis eines Star-Schemas für das Berichtsmodul in Snowflake.

- Analyse von Flat Files und DB2-Datenquellen sowie Definition von Dimensions- und Faktentabellen.

- Bearbeitung von Daten in Snowflake mittels Snowpark DataFrames.

- Erstellung von PDF-Berichten mit ReportLab in AWS Lambda und Ablage auf S3.

- Definition und Deployment von Lambda-Funktionen mit Terraform sowie Orchestrierung über AWS Step Functions und EventBridge.

- Aufbau von DataStage-Strecken für Spar-, Darlehens- und Zahlungsverarbeitungen sowie Controlling-Themen (FATCA, CRS).

- Erstellung komplexer SQL-Abfragen, Funktionen und Prozeduren für Snowflake auf AWS.

- Entwicklung von Shell-Skripten zur Automatisierung administrativer Aufgaben wie Versionierung und Deployment.

Experte für Datenbankmodellierung, Entwicklung und Talend

Intersport AG

- Talend 6.5.1 / 4.2, SVN, Java, Maven, PowerShell, Elasticsearch, Spring Boot, Mulesoft ESB, Windows 10, Exasol 6.0 / 4.0, MSSQL Server 2017, SAP Hana 4, SAP BW 7.0

- Analyse der Fachbereichsanforderungen und Integration in ein zentrales Datenmodell.

- Reverse Engineering von Datenmodellen aus SQL Server und PostgreSQL sowie Anpassung für Exasol.

- Migration und Weiterentwicklung von Talend-Strecken für Verkauf, Bestellungen und Controlling.

- Entwicklung und Optimierung von T-SQL Views, Funktionen und Prozeduren auf dem SQL Server.

- Entwicklung von ETL-Prozessen zur Übertragung von Bestelldaten zwischen SAP BW und Exasol sowie Beladung von Elasticsearch-Indizes.

- Entwicklung von Maven-Skripten für die kontinuierliche Integration generierter Java-Artefakte.

- Automatisierung administrativer Tätigkeiten und Testdatenbereitstellung mittels PowerShell-Skripten.

- Implementierung der Verkaufsdatenübertragung an Empfehlungsdienste über REST-/JSON-APIs unter Einsatz von MuleSoft ESB.

- Design einer Lösung zur Datenübertragung an den Web-Shop über Web Services mit Java und Spring Boot.

Experte für Data Warehouse und Talend

DB Energie AG

- Amazon AWS (Redshift, DynamoDB, Lambda, Glue, S3), Teradata, SQL Server 2016, Talend 6.2, Java, Tableau 10.4, Python, Git

- Entwicklung von Talend-Strecken für Controlling- und Marketingthemen.

- Migration von Teradata BTEQ-Skripten nach Talend.

- Weiterentwicklung bestehender BTEQ-Beladungsskripte.

- Entwicklung von Python-Skripten zur Testdatenbereitstellung und Ergebnisbewertung.

- Entwicklung von JIRA Stories zur Befüllung spezifischer Warehouse-Schichten nach Data Vault 2.0 Prinzipien.

- Entwicklung von Business Views und Tableau-Dashboards zur KPI-Visualisierung.

ETL Experte

Bausparkasse – Deutsche Bank AG

- MS SQL 2016, SSIS, SSAS, SSRS, Git

- Entwicklung von SSIS-Strecken für die Beladung von Data Vault 2.0 Satelliten-, Hub- und Link-Tabellen.

- Entwicklung von Testfällen zur technischen und fachlichen Prüfung der SSIS-Jobs.

- Entwicklung von Point-in-Time-Tabellen für schnellen KPI-Zugriff.

- Erstellung von Materialisierungsskripten zur Abfrageoptimierung vor SSRS-Berichtsausführung.

- Begleitung von Test- und Rollout-Phasen.

- Entwicklung von Shell-Skripten zur Automatisierung administrativer Tätigkeiten und Testdatenbereitstellung.

Experte für DB2, Java und Talend

VHV Versicherungen

- Talend 5.4, Java, Scala, DB2 LUW 10.1/10.5, Redhat Enterprise 6.6, LDAP

- Weiterentwicklung von Talend-Strecken zur Anonymisierung personenbezogener Daten.

- Weiterentwicklung des Berechtigungskonzepts für Daten im Ruhezustand auf DB2 mittels LDAP-Gruppen.

- Testfallentwicklung mittels HPQC und Begleitung des Produktions-Rollouts.

- Weiterentwicklung einer Spring Boot-basierten Java-Anwendung für Schadens- und Anspruchs-APIs.

- Implementierung von REST-basierten Microservices für das Bestandsprojekt.

- Entwicklung und Test von Strecken zur Ermittlung des fachlichen Bestands aus Kundeninteraktionen in einem Data Vault Modell.

Experte für Oracle, Linux und UC4

Postbank AG

- JBoss/Tomcat, UC4, Bash, Oracle 12c, Nagios, Solaris 11.3, Redhat Enterprise 6.6

- Weiterentwicklung von UC4-Strecken zur Dateiübertragung und zugehöriger Shell-Skripte.

- Überwachung von UC4-Jobabläufen, Fehleranalyse und Einspielung von Patches.

- Bearbeitung von Bestellaufträgen für Hardware, Software und Freischaltungen.

- Installation und Sicherheitsanpassungen an UC4 sowie UC4-Agenten.

Experte für Oracle, PowerCenter und XML

Sopra Steria

- XML, XSLT, XPath, Oracle 12c, Oracle Data Integrator 12, Solaris, KSH, UC4, Enterprise Architect

- Entwicklung von Oracle-Abfragen und PL/SQL-Packages.

- Entwicklung von ODI-Strecken, KSH-Skripten und UC4-Jobs zur Beladung eines Reporting Data Marts.

- Überwachung von UC4-Abläufen, Fehleranalyse und Defektmanagement mittels HPQC.

- Dokumentation von Datenbankänderungen mit Enterprise Architect.

- Generierung von CRS-Berichten im XML-Format für das Bundesamt für Steuern.

Unterstützung DWH Packet Warehouse

Sopra Steria

- WebSphere MQ 7.5, Oracle 11g, Teradata 14.1, MS SQL 2012, Talend 5.6.1, PowerCenter 9.6, Business Objects, PHP 5, Red Hat Linux 6.6, Nagios, Control-M, Shell (Bash), SVN

- Design und Entwicklung von ETL-Strecken mittels Talend für Beladung, Historisierung und Datenzusammenfassung neuer Produkte (DHL Packstationen).

- Wartung und Weiterentwicklung bestehender Informatica PowerCenter Strecken.

- Planung und Durchführung von Last- und Performance-Tests für bis zu 3000 XML-Nachrichten pro Sekunde.

- Entwicklung von Shell-Skripten zum Monitoring von Queues und Speicher während LUP-Tests.

- Entwicklung von BTEQ- und Shell-Skripten zur Bereinigung von Großkundendaten.

- Beladung von Daten aus REST-Abfragen (JSON) von Lagern und Paketkästen.

- Anpassung von ca. 40 Berichten in PHP und PDF.

- Entwicklung von RPMs zur Automatisierung von Deployments.

Unterstützung OSPlus Financial Warehouse

Finanz Informatik – Solutions Plus

- Oracle 11g, Postgres EnterpriseDB, Gupta SQL, Talend Data Integration 5.5.1, Talend Big Data 5.6, Jasper Reports 5.6/6.0, Ubuntu Linux 14.04, Bash, SVN, Git

- Design und Entwicklung von ETL-Strecken für Beladung und Historisierung neuer Produkte in Richtung Warehouse.

- Automatisierung von Abläufen durch Shell-Skripte und Job-Exporte.

- Entwicklung von Deployment-Skripten für die Talend Application Console (TAC).

- Bearbeitung von JIRA-Tickets für ETL-Strecken und Berichte.

- Upgrade des Talend Data Integration Servers und Installation von Talend Big Data sowie Cloudera.

- Entwicklung von ETL-Strecken mittels tSpark-Komponenten in Verbindung mit Spark-Enabled Clustern.

- Upgrade von Jasper Reports von Version 5.6 auf 6.0.

Unterstützung Release und Produkt Management

DFV – Deutsche Familien Versicherung

- vSphere v5.1, Windows Server 2008, MS SQL Server 2012, DB2 LUW 9.6, SSIS, SSAS, SSRS, Red Hat 6.6, PowerDesigner 16, SVN

- Installation und Wartung von SQL Server 2012 Umgebungen.

- Entwicklung von SSIS-basierten Datenmigrations-Strecken und PowerShell-Skripten.

- Durchführung der Migration und Entwicklung von Reparatur-Skripten.

- Design und Entwicklung einer spaltenorientierten Reporting-Datenbank (ODS) mittels PowerDesigner.

- Migration und Weiterentwicklung operativer Berichte von Cognos auf eine Microsoft-BI-Architektur.

- Aufbau eines SSAS-Tabular-Modells als semantische Schicht mit DAX-Kennzahlen.

- Entwicklung von Skripten zur Job-Ausführung und Log-Auswertung.

Experte für Oracle und JBoss

DER Touristik

- WebLogic 10.3.9, MongoDB, Elasticsearch, HTML/CSS/JavaScript, Oracle 11gR2, PL/SQL, SQL Developer, Gupta SQL, Spring, Eclipse, Tibco EMS, JUnit, Oracle Enterprise Linux 6.1, Informatica PowerCenter, Nagios

- Definition und Weiterentwicklung von Schnittstellen zwischen Touristik-Anwendung und SAP Rechnungswesen.

- Entwicklung einer PowerCenter-basierten Lösung zur Bearbeitung von Änderungen in Reiseverträgen.

- Performance-Optimierung durch Auslagerung der Hotelsuche von Oracle nach MongoDB.

- Entwicklung von Shell- und Perl-Skripten zur Automatisierung des PowerCenter-Rollouts.

- Speicherung und Einspielung von Testdaten für verschiedene Szenarien mittels PowerCenter.

Experte für Datenmodellierung und ETL-Prozesse

SEB Bank

- Bash, Perl, DB2 LUW 8.5, MS SQL 2008, MySQL, Oracle 11, PL/SQL, Toad Data Modeler 4.1, PowerDesigner 16, Java, PowerCenter 8.6/9.1, Talend Open Studio, Red Hat Enterprise 5.4

- Begleitung von PowerCenter-Abläufen für Kontoanlage und Kundendaten.

- Performance-Optimierung durch Indizes, Statistiken und Materialized Views.

- Extraktion und Archivierung von Privatkundendaten im GDPdU-Format.

- Aufbau eines MySQL-Data-Warehouses in einer Linux-Umgebung mittels Talend.

- Qualitätssicherung der Extraktion durch Laden in IDEA-Anwendungen.

- Konzeption und Realisierung von Trennungs-ETL-Strecken in PowerCenter zur Separierung von Daten.

- Durchführung von Separierungs-Jobs und Vorbereitung der Datenlieferungen gemäß Finanzministeriumsvorgaben.

Experte für Datenbanken

HRS

- JBoss 4.2 / 7.1, Spring, Maven, HTML/CSS/JavaScript, IBM DB2 LUW 9.5, Postgres, PostGIS, Nagios, MS SQL Server 2005, Pentaho Kettle

- Tuning und Weiterentwicklung von SQL-Abfragen zur Performance-Steigerung.

- Ablösung Hibernate-generierter Abfragen durch optimierte DB2-Abfragen.

- Entwicklung von DB2-Skripten für Wartung und Testdatenbereitstellung.

- Liaison für in Russland entwickelte Projekte (Change Requests in JIRA).

- Umwandlung von C++ und Shell-basierten Beladungsstrecken in Pentaho-Strecken.

- Entwicklung von ETL-Jobs mit Pentaho Kettle zur Datenextraktion von DB2 nach MS SQL für das Berichtswesen.

Experte für DataStage, Oracle und XML

IBM Germany

- XML, XSLT, XPath, Oracle 10g, PL/SQL, DB2 LUW 8.1, Cobol, JCL, CICS, Connect Direct, BMC, Tivoli TWS, Sybase IQ, IBM WebSphere MQ 6.0, DataStage 8.1

- Wartung von DB2, WebSphere MQ und DataStage über mehrere Umgebungen und Instanzen.

- Implementierung von Sicherheitskonzepten und Skriptentwicklung.

- Entwicklung von Oracle-Packages zur Bearbeitung von XML-Zeichenketten über SOAP.

- Entwicklung von ETL-Jobs zur Sicherung und Wiedereinspielung von Daten-Snapshots.

- Orchestrierung von DataStage-Ladevorgängen mittels Tivoli TWS.

- Anreicherung von Kundendaten mit Portfolio-Daten aus Sybase IQ.

- Entwicklung von Shell-Skripten zur Softwareverteilung und Automatisierung von Komponenten.

Experte für WebLogic, MS SQL, XML und Java/J2EE

Amadeus Germany

- JBoss 4.0x, WebLogic 10, XML, XSLT, XPath, Talend 4.x, Oracle 10g, JSP, Struts2, HTML/CSS/JavaScript, IBM WebSphere MQ 6.0, MS SQL 2005

- Dokumentation von XML-Schnittstellen für den Datenaustausch nach dem OTA-Datenmodell.

- Entwicklung einer WSDL/SOAP-basierten Schnittstelle zur Kommunikation zwischen CRM und Front Office.

- Implementierung der Datenpersistenz für verschiedene Komponenten.

- Realisierung von Schnittstellen zu Systemen von Fluglinien und Reiseveranstaltern.

- Entwicklung von Talend-ETL-Jobs zur Bereitstellung von Testdaten.

Entwickler Front Office Intranet-Anwendung

Europäische Zentralbank

- Solaris, Tomcat, XML, XSLT, XPath, HTML/CSS/JavaScript, Oracle 10g, PL/SQL, Jasper Reports, Aptech Gauss Engine

- Implementierung von PL/SQL-Packages zur Datenvorbereitung für Berichte.

- Dokumentation von XML-Schnittstellen zwischen Nationalbanken und der EZB.

- Entwicklung einer Softwareschicht zur Datenintegration in Staging-Tabellen.

- Visualisierung von Daten aus der Aptech Gauss Engine.

- Entwicklung von Berichten mit Jasper Reports.

Experte für JBoss, Oracle, XML und Java/J2EE

Amadeus Germany

- JBoss 4.0x, XML, XSLT, XPath, HTML/CSS/JavaScript, Oracle 10g, JSP, Struts, IBM WebSphere MQ 6.0

- Dokumentation von XML-Schnittstellen für die Amadeus Suchmaschine.

- Entwicklung einer WSDL/SOAP-basierten Schnittstelle zur Erfassung von Reiseangeboten.

- Implementierung der Datenpersistenz.

- Entwicklung eines Lifecycle-Mechanismus für Angebots-Updates.

- Entwicklung von Transformationen aus dem OTA-Format in interne XML-Repräsentationen inklusive Performance-Optimierung.

- Entwicklung einer MQ-basierten Schnittstelle zur Interaktion mit dem Portal.

- Erstellung einer JSP-basierten Administrationskonsole für Reiseveranstalter.

Experte für Oracle, JBoss und Informatica PowerCenter

Lufthansa Systems AG

- HP-UX, Oracle 9i, PL/SQL, Tibco Data Exchange, Toad, XML, XSLT, JBoss, Struts, Microstrategy 8

- Design und Implementierung der Transformationen für das Data Warehouse.

- Erweiterung eines Snowflake-Datenmodells für die Kapazitäts- und Einnahmenplanung.

- Entwicklung von Shell-Skripten zum Abrufen von PowerCenter-Strecken aus Versionsmanagement-Systemen.

- Implementierung von AutoSys Scheduling zur Reduzierung manueller Eingriffe.

- Entwicklung von ETL-Strecken für Zahlungsberichte in Microstrategy.

Berater für Datenmigration

Moore Wallace

- Solaris, Sybase, Oracle, Java, Perl, Shell

- Beratung und Entwicklung im Bereich Datenmigration von Sybase nach Oracle im Solaris-Umfeld.

Berater für Integration

Aviva Canada

- Linux, Eclipse, JBoss, WebSphere 5.1, IBM WebSphere MQ, XML, PostgreSQL, Oracle, PL/SQL, OpenLDAP, PowerCenter 7.1, Perl, Shell

- Dokumentation des Datenaustauschs zwischen Mainframe, Oracle Financials, DB2 und Netezza-Warehouse.

- Einsatz von WebSphere MQ und JBoss JMS für XML-basierte Business Events nach OAGIS 8.1 Standard.

- Entwicklung von Pflichtenheften mit Use Cases und Interaktionsdiagrammen.

- Entwicklung von Java/MQ-Prozessen zur Speicherung von Mainframe-Informationen in Staging-Tabellen.

- Design und Entwicklung von PowerCenter ETL-Strecken zur Beladung von Netezza-Tabellen.

Berater Finanz-Reporting-Subsystem

Swiss Re Global Development Services

- Solaris, Oracle 9i, JReport, WebSphere 5.1, Eclipse, CVS, Rational Rose, Business Objects

- Beratung und Entwicklung eines Finanz-Reporting-Subsystems.

- Durchführung von Geschäftsprozess-Analysen und Dokumentation.

Entwickler und Integrator für Data-Mining

The Monitoring Company

- Java, WebLogic, XML, Sybase, Oracle, MS SQL

- Tätigkeit im Bereich Marken- und Patent-Data-Mining.

Architekt / Senior Entwickler

Entertainment Partners Canada

- Java (Swing, J2EE), XML, XSLT, IBM WebSphere 4, IBM DB2 7.2, Mac OS X, Linux

- Implementierung von Multiplattform Java Swing-basierten Planungsanwendungen für die Filmproduktion.

- Entwicklung des Movie-Magic Schedulers als Stand-alone-Anwendung mit XML-Datenabgleich.

- Anwendung des RUP-Entwicklungsprozesses.

Anwendungsintegrator

BCE Emergis, Assure Health Group

- Solaris, Oracle, Java, WebLogic, HL7

- Integration der eFilm-Anwendung mit Cerner HMS.

- Produktvorbereitung für die ONC-Zertifizierung.

Unterstützung Entwickler-Team

Merge Technologies

- Solaris, MS SQL 6.5, Java, C++, HL7

- Realisierung eines Workflow-Management-Systems inklusive Reporting im Bereich Radiologie.

- Implementierung der Lösung beim Pilotkunden Mount Sinai Hospital in Toronto.

Berater für Banking- und Finanzlösungen

IBM Canada

- Beratung während der Design- und Implementierungsphase eines Thin Client PoS für das Bank- und Versicherungsgewerbe.

Berater Bewertungssystem

Chubb Insurance Company of Canada

- Beratung während der Design- und Implementierungsphase eines Systems zur Bewertung von Privatversicherten.

Gründer

Netup Communications

- Gründung der Firma Netup Communications.

- Durchführung verschiedener Zeitverträge und Projekte als freiberuflicher Berater.

Berater für Powerbuilder/Sybase-Lösungen

Deloitte & Touche Consulting Group

- Verbesserung einer Powerbuilder/Sybase-Lösung für sicheres entferntes Arbeiten über WANs unter Einsatz von IBM DCE.

Anwendungsentwickler GIS

SHL Systemhouse

- Anwendungsentwicklung mit Powerbuilder und Oracle.

- Hard- und Software-Integration sowie Deployment im Bereich GIS.

Softwareentwickler

Delrina Corporation

- Software-Entwicklung in einem internationalen Team.

Entwickler klinische Verfahren

McMaster University, Hamilton

- Entwicklung im Bereich klinische Verfahren unter Einsatz von C, Motif und SunOS.

Branchenerfahrung

Sieh, in welchen Branchen dieser Freelancer den Großteil seiner beruflichen Laufbahn verbracht hat.

Erfahren in Informationstechnologie (IT), Telekommunikation, Bank- und Finanzwesen, Versicherung, Regierung und öffentliche Verwaltung und Gesundheitswesen.

Erfahrung nach Fachbereich

Zeigt, in welchen Abteilungen und Funktionen dieser Freelancer am meisten mitgewirkt hat.

Erfahren in Informationstechnologie (IT), Business Intelligence, Produktentwicklung, Qualitätssicherung, Forschung und Entwicklung (F&E) und Finanzen.

Zusammenfassung

Mr. Paunel ist ein ETL- und Datenbankspezialist mit über 20 Jahren Erfahrung im System Engineering und hat schwerpunktmäßig in den Bereichen Banking, Versicherung und Consulting gearbeitet, wobei sein Fokus auf ETL-, Datenbank- und Integrationsprojekten liegt. Anfang der 2000er Jahre war er an verschiedenen Java-Entwicklungs- und Integrationsprojekten beteiligt.

Seit 2005 ist er in Deutschland als freiberuflicher IT-Spezialist (Freiberufler) registriert und hat an vielen Produktivrollout-Projekten mitgewirkt, in denen er Herausforderungen im Bereich Datenbankperformance und -optimierung übernommen hat, in Umgebungen, in denen ETL-Pipelines mit Oracle-, DB2-, MS SQL-, Postgres- und MySQL-Datenbanken interagieren. Seine Erfahrung mit Migrationsprojekten hat es ihm ermöglicht, seine ETL-Fähigkeiten zu vertiefen und Expertise mit folgenden Tools zu entwickeln: Talend, DataStage, SSIS und Azure Data Factory.

Fähigkeiten

Branchen: Banken: Ezb, Deutsche Bundesbank, Commerzbank, Seb Bank, Deutschebank, Postbank, L-Bank, Ing; It-Consulting: Fiducia, Sopra Steria, Finanz Informatik Solutions Plus, Ibm Global Solutions, Lufthansa Systems, Deloitte & Touche, Bce Emergis; It-Firmen: Symantec/Delrina; Versicherungen: Kkh, Vhv, Da Direkt, Helvetia Versicherungen, Dfv-Deutsche Familien Versicherung, Aviva Canada, Assure Health, Chubb Insurance, Swiss Re; Reiseveranstalter: Der Touristik, Hrs, Amadeus; Logistik: Dhl, Intersport, Lufthansa Cargo

Datenbanken: Oracle (11j), Ibm Db2 (8j), Sybase (4j), Ms-Sql Server (2000-2022, Inklusive Ssis, Ssrs, Ssas – 5j), Mongodb, Postgres, Sybase As Und Iq, Mysql, Exasol

Etl: Datastage (8.1, 11.7 – 8j), Talend (V4, 8.3 – 6j), Pentaho (4.1-9.0), Dbt, Informatica Powercenter (V7.1-9.6), Ssis EinschließLich Azure Data Factory

Bi/Reporting: Qlik, Tableau, Powerbi, Business Objects, Jreport, Cognos Analytics (V8, V11), Microstrategy (V8, V9, V10.1)

Tools: Quest Toad, Spotlight For Oracle, Dbartisan, Powerdesigner, Erwin, Redgate FüR Ms Sql

Programmiersprachen: Java (14j), Python (4j), Xml-Technologien (6j), C/C++ (2j), Powerbuilder (3j), Skriptsprachen (Php, Perl, Bash, Ksh, Powershell)

J2ee-Technologien: Servlets/Jsf, Hibernate, Swing, Jms, Jmx, Web Services

Application-Server: Ibm Websphere (3j), Weblogic (2j), Apache/Tomcat, Mq Series 5-8.5, Jboss (5j – Certified Consultant)

Betriebssysteme/Cloud: Windows, Linux (Ubuntu, Redhat), Aws (S3, Glue), Azure (Adlsv2, Azure Sql Database, Data Factory, Terraform), Aix 5.3, Solaris, Osx

Ooa/Ood: Rup, Uml (Magicdraw, Rational Rose, Together J)

Web: Jsp/Servlets, Struts, Jsf, Javascript, Html, Css

Sonstige: Ant, Maven 3, Active Directory, Liquibase, Cvs, Svn, Git, Jenkins, Docker, Ansys, Jprofiler, Openldap, Soapui, Postman

Sprachen

Ausbildung

Universität Bukarest

Master, Schwerpunkt Mess- und Kontroll-Technik · Angewandte Physik · Bukarest, Rumänien

Zertifikate & Bescheinigungen

JBoss Certified Consultant

Statistiken

Erfahrung

Globale Erfahrung

Fachkenntnisse

Qualifikationen

Profil

Häufig gestellte Fragen

Du hast Fragen? Hier findest du mehr.

Durchschnittlicher Tagessatz für ähnliche Positionen

Die Tagessätze basieren auf aktuellen Projekten und enthalten keine FRATCH-Marge.

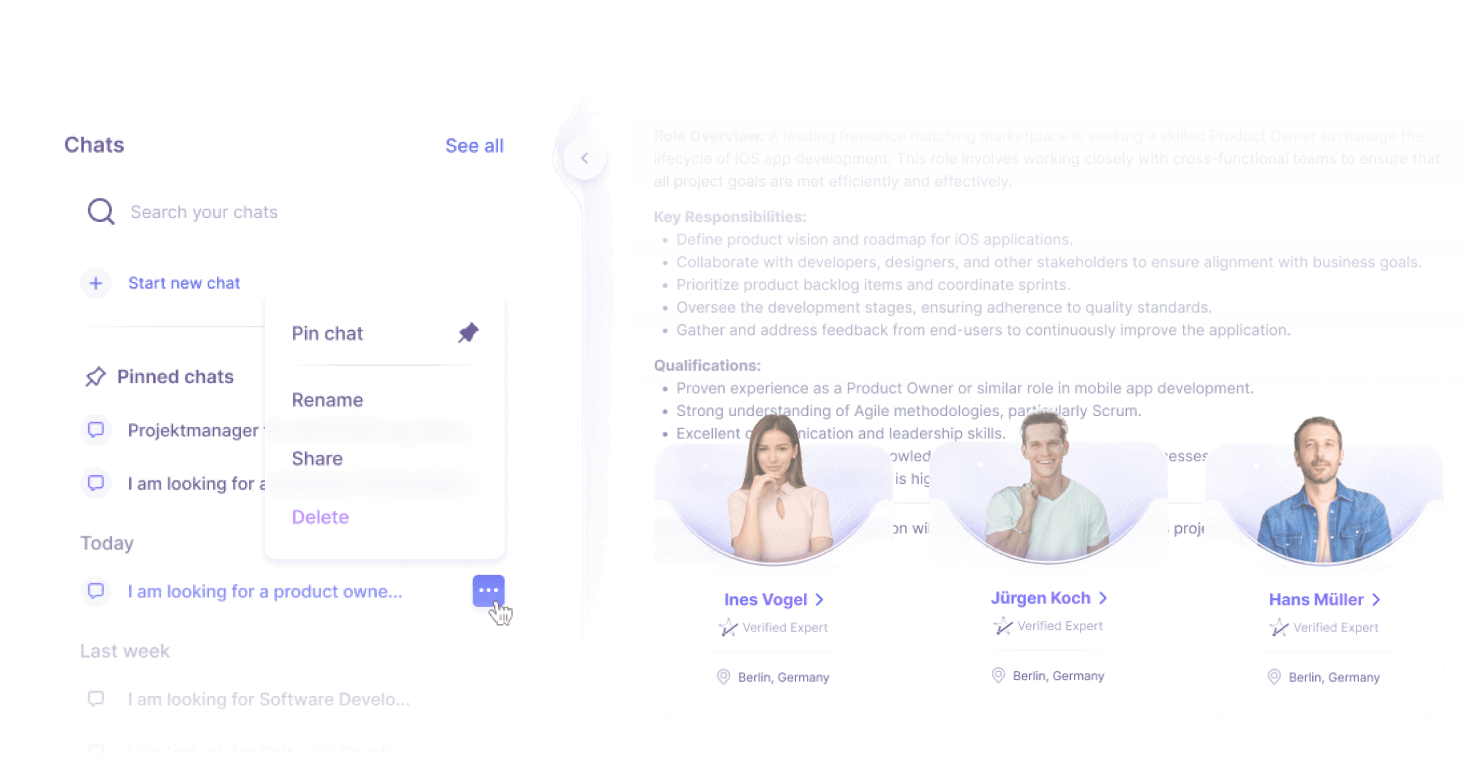

Ähnliche Freelancer

Entdecke andere Experten mit ähnlichen Qualifikationen und Erfahrungen

Experten, die kürzlich an ähnlichen Projekten gearbeitet haben

Freelancer mit praktischer Erfahrung in vergleichbaren Projekten als DataStage ETL Experte

Freelancer in der Nähe

Fachkräfte, die in oder in der Nähe von Steinbach (Taunus), Deutschland arbeiten